近日,我中心一篇情感计算方向论文“Multi-Views Emotional Knowledge Extraction for Emotion Recognition in Conversation”被Knowledge-Based Systems(中科院一区、JCR-Q1)期刊录用。论文由我中心的博士生简忠权+,玛希隆大学硕士生吴岱航+,厦门大学博士生王少攀+、何捷舟,厦门大学姚俊峰教授、刘昆宏教授、吴清强教授*共同完成。

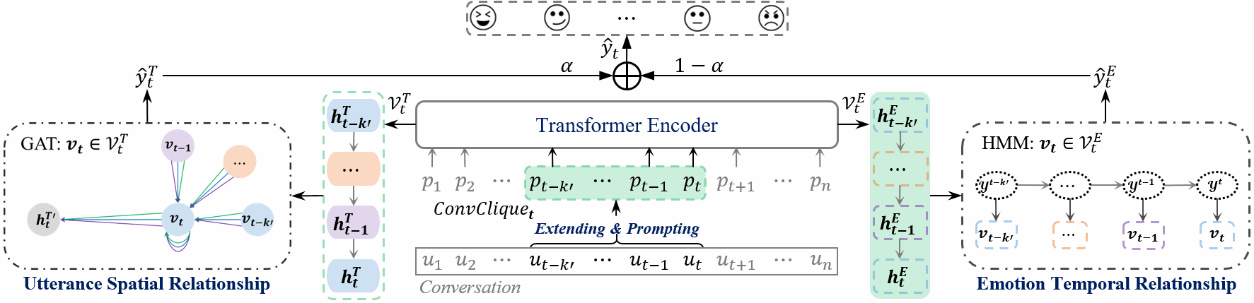

对话中的情感识别(ERC)是一项具有挑战性的任务,原因在于上下文信息在各话语中的稀缺性和分散性。大多数现有的方法试图整合全面的信息以增强话语语义,然而这也会引入噪声和不相关的内容,误导模型并限制其在情感识别方面的潜力。为此,我们引入了对话团(ConvClique)的概念,并提出了CC-ERC。这是一种多视角情感知识提取方法,旨在从互补的角度捕捉对话团中最相关的情感线索,并协同预测话语情感。具体而言,CC-ERC包含两个模块:1)话语空间关系(USR)模块,通过建模话语之间的结构相关性来预测情感;2)情感时间关系(ETR)模块,捕捉情感序列模式以确定话语情感。在三个广泛使用的ERC数据集上对CC-ERC的有效性进行了验证,评估了在线和离线两种设置。与最先进的方法相比,CC-ERC在准确率上平均提高了0.63%,在加权F1分数上平均提高了0.94%。消融研究进一步验证了基于ConvClique的知识提取的重要性,并展示了USR和ETR模块在建模话语结构相关性和情绪序列模式方面的有效性。